News - La desinformación generada por la IA genera tensiones raciales y tiene un impacto político

Business Strategy

La desinformación generada por la IA genera tensiones raciales y tiene un impacto político

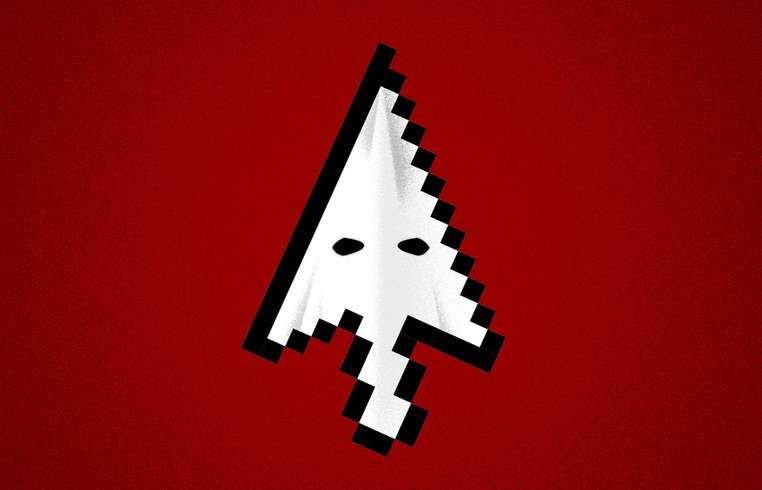

En el cambiante panorama de la inteligencia artificial, la creación y distribución de videos generados por IA se han vuelto alarmantemente fluidas y convincentes. Esta facilidad de fabricación, utilizando herramientas como Sora de OpenAI y VEO 3 de Google, está alimentando la proliferación de contenido artificial, que es cada vez más difícil de distinguir de los medios auténticos. Estos avances han dado lugar a un nuevo fenómeno digital semejante al 'blackface', en el que individuos no negros crean videos de personajes negros o marrones para acumular capital social, como 'me gusta', compartidos y, en algunos casos, ganancias monetarias. Esta tendencia tiene implicaciones inquietantes, especialmente dado que las plataformas de redes sociales incentivan la creación de contenido a través de ingresos por visualizaciones. La insidiosidad de estos videos generados por IA reside no solo en su naturaleza engañosa, sino también en su potencial para perpetuar estereotipos raciales e influir en la percepción pública. Una serie de videos fraudulentos que mostraban a supuestas mujeres negras discutiendo sobre el abuso de los beneficios SNAP durante un cierre gubernamental desató una ola de vitriolo en línea. Estos videos perpetuaban el dañino estereotipo de las mujeres negras como 'reinas de la asistencia social', un cliché que lamentablemente llevó a algunos usuarios a oponerse al mismo programa SNAP. Notablemente, los datos estadísticos contradicen esta narrativa con el hecho de que la mayoría de los beneficiarios de SNAP son individuos blancos no hispanos. Sin embargo, el atractivo de contenido que aparentemente valida prejuicios preconcebidos a menudo lleva a los usuarios a pasar por alto los hechos en favor de la resonancia emocional. Esta dinámica subraya la potente influencia de la desinformación en las plataformas sociales. Michael Huggins, del grupo de justicia racial Color of Change, destacó el impacto psicológico de dicho contenido fabricado. Incluso cuando los espectadores identifican el contenido como falso, sus connotaciones negativas pueden infiltrarse inadvertidamente en la mentalidad colectiva, moldeando actitudes hacia problemas del mundo real, incluidas las elecciones políticas. Si bien algunas empresas tecnológicas están avanzando para mitigar la propagación de contenido manipulador mediante la incorporación de políticas contra el discurso de odio y la desinformación, aún hay margen de mejora. OpenAI y Google han instituido varias salvaguardas, como la prohibición de insultos y la implementación de marcas de agua digitales para señalar el contenido generado por IA. No obstante, el alcance e impacto de estos videos continúan presentando desafíos significativos. Según la psicóloga organizacional Janice Gassam Asare, la frivolidad con la que a menudo se consume este contenido es precisamente lo que lo hace tan pernicioso. Ella exhorta a un discernimiento entre los consumidores de redes sociales, alentando evaluaciones críticas de la autenticidad del contenido. Esta lucha continua contra la desinformación impulsada por IA habla de tendencias más amplias en la transformación digital y las dinámicas sociopolíticas, subrayando la urgencia de una mayor conciencia y responsabilidad de las plataformas para salvaguardar los valores sociales y los procesos democráticos.